数字出海合规启示录(一):Clearview AI出海浮沉——当AI撞上全球数字监管

数字出海合规启示录(一):Clearview AI出海浮沉——当AI撞上全球数字监管

一、案件背景

(一)Clearview AI业务介绍

Clearview AI是一家总部位于美国的科技公司,成立于2017年,主要营业地点是纽约市。作为一家初创AI公司,Clearview AI的业务饱受争议,近年来遭受了各国监管的重点关注。

Clearview AI的核心业务是提供大规模面部识别数据库服务。首先,Clearview AI通过爬取(Scraping)社交媒体帖子、个人和专业网站、新闻文章、犯罪数据库、公共记录网站以及数千个其他公开来源中的人脸图像。在未经数据主体的知情和同意的情况下,将这些数据永久存储,并通过神经网络算法进行分析。算法将每张人脸转化为由512个数据点组成的独特数字表示,形成人脸向量(Face Vector)数据,截至2025年12月,Clearview AI 已存储了600亿的人脸图像向量数据库(Vector Database)。[1]用户上传探针图像(Probe Image)后,Clearview AI就该探针图像进行分析并生成人脸向量,后在人脸图像向量数据库中就该探针图像的人脸向量进行搜索匹配,返回面部图像结果以及公共图像的来源网址,最终用户通过进一步的调查步骤验证并确认返回的结果。

在2020年前,Clearview AI以美国和加拿大为核心,客户主要分为执法机构、私营企业、个人三类,并通过免费试用的模式进行推销,迅速覆盖包括澳大利亚、英国、比利时、巴西、中东等在内的其余25个国家和地区。[2]

目前,Clearview AI的主要服务机构为执法机构和政府机构,用于执法调查犯罪、国家安全与国防等公共领域,不再向私营企业和个人提供服务。美国仍是其核心市场(但不包括对人脸识别技术存在限制的佛蒙特州、新泽西州、伊利诺伊州、缅因州、马萨诸塞州和蒙大拿州),Clearview AI不向英国、欧盟、加拿大和澳大利亚提供服务。[3]

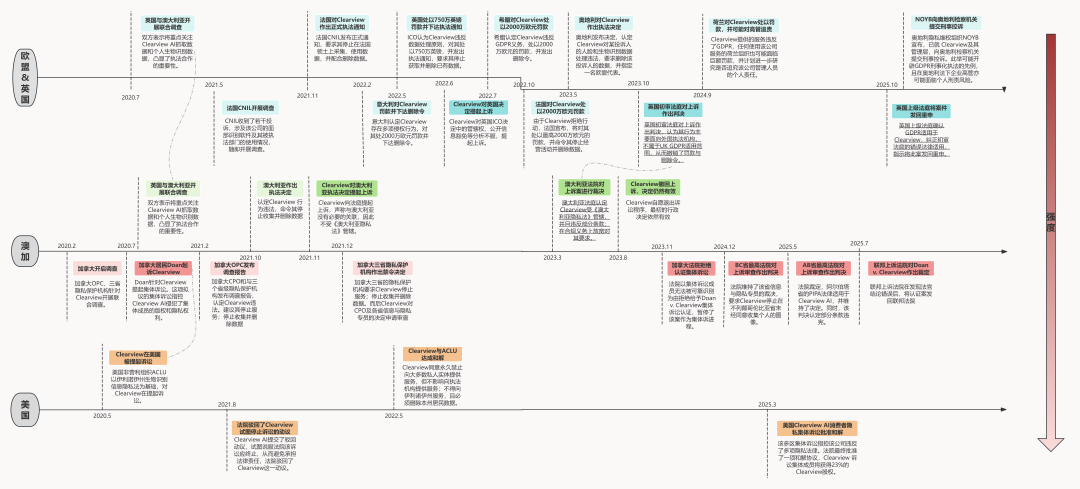

(二)Clearview AI遭遇多国监管风波

2020年1月,Clearview AI大规模网络抓取和面部识别数据库的业务经新闻报道引发全球关注。英国、澳大利亚、加拿大等多国执法机构先后就Clearview未经个人同意处理用户人脸信息的行为展开调查和执法,并对其处以数以千万计的罚款,且要求其停止收集人脸数据及删除已存储的人脸数据;美国、加拿大等地的消费者也对其提起了诉讼。

点击可查看大图

二、Clearview AI系列事件争议焦点分析

Clearview AI饱受争议的行为是在全球范围内的公开渠道爬取人脸图像,在未经个人信息主体同意的情况下处理人脸图像并存储,后续为执法机关提供图片匹配服务,且未履行任何合法性基础审查、透明度义务、目的限制评估,也未为数据主体提供访问、更正、删除等权利渠道。

在Clearview AI的行政执法和司法案件中,主要的争议焦点共有:(1)域外法适用争议;(2)Clearview AI的行为是否违反了各辖区的隐私保护法律。下文将逐一展开分析。

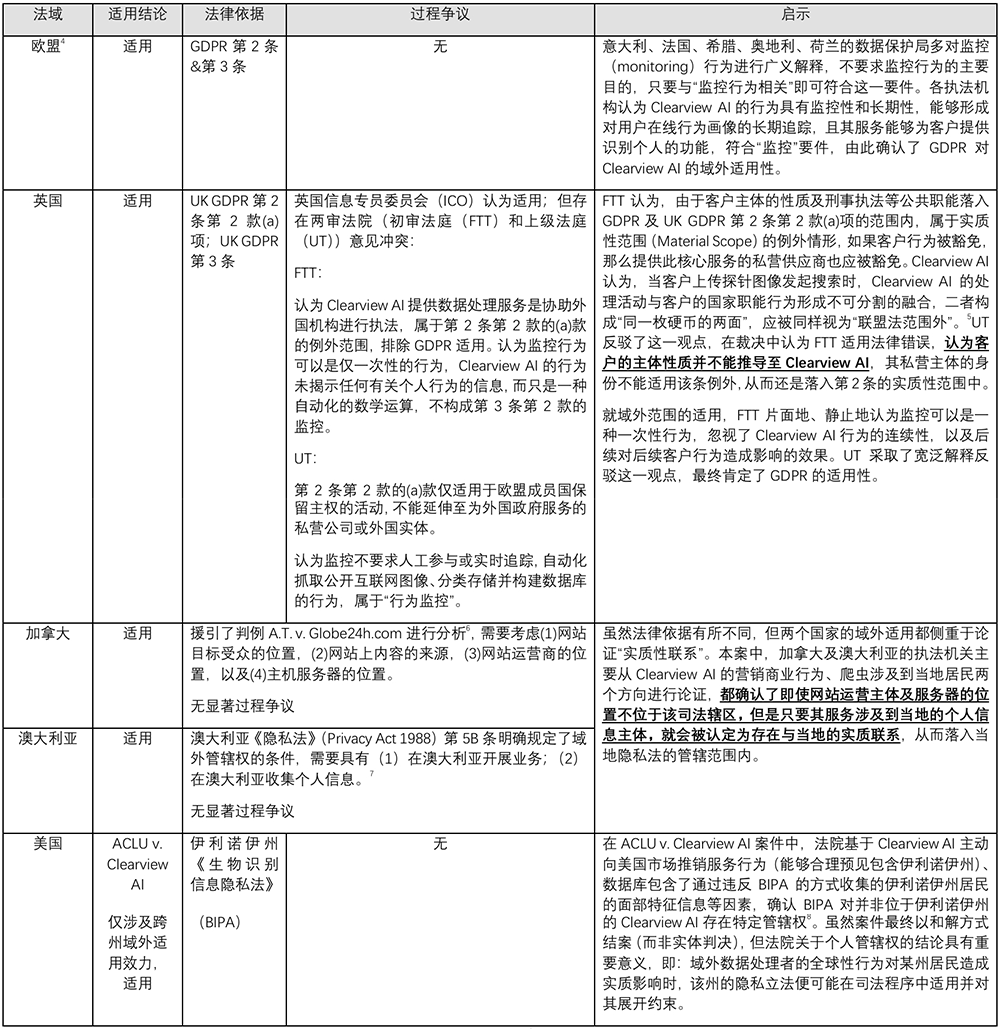

(一)关于域外法律的适用争议

Clearview AI 作为一家美国AI公司,公司主要营业地点位于美国纽约州,根据公开执法文件及 Clearview AI 在相关监管程序中的陈述,该公司未在美国境外设立法人实体、分支机构或指定代表,其数据处理基础设施亦被说明主要位于美国境内。因此,各国的法律是否对Clearview AI 有管辖权成为首要争议。Clearview AI以其未曾在当地开展服务,也没有在当地设立任何机构为抗辩,否认该国法律对其的适用。对此,各国执法机构和司法机关都作出了否定性评价。

点击可查看大图

2020年以来,在受到前述各国监管调查执法后,Clearview AI开展业务的地域范围受到显著影响。截至2025年12月,Clearview AI在美国法域下与ACLU达成和解,不向其他私营主体提供服务,并声称不在欧盟、英国、澳大利亚和加拿大提供技术服务[9]。然而,关于其是否已全面履行各国监管机构作出的缴纳罚款、删除数据、停止处理等决定,公开信息层面尚难以核实。有独立调查媒体于2025年4月16日发布的文章称由于执行和程序等原因Clearview AI 并未缴纳罚款(欧盟监管机构总处罚金额将近1亿欧元),部分监管机构例如荷兰DPA计划调查Clearview AI公司董事是否应因违反GDPR而承担个人责任[10], 欧盟数据保护非政府组织noyb于2025年10月28日对Clearview AI及其管理人员提起刑事诉讼[11]。此外,Clearview AI 是否已彻底停止相关数据抓取行为并完成全部数据清除,仍缺乏可公开验证的结论。

(二)关于爬取公开人脸信息的违法性争议

各国监管部门大体上采取了类似的认定逻辑,认为公开的个人信息并不能无条件利用,Clearview AI爬取公开的人脸信息超出了主体的合理预期范围,在没有获取个人同意的情况下,Clearview AI的处理行为也不符合合法利益的范围,因此不具有合法基础;但也有部分国家对Clearview AI采取较为宽松的态度,具体分析如下。

1、严格保护:以欧盟法域为代表

(1)欧盟及英国法域

GDPR对隐私保护的力度是全球范围内最严格、最全面的法律框架之一,其建立的原则和义务彻底否定了Clearview AI商业模式的合法性。

具体而言,Clearview AI最核心的违法行为是爬取公开人脸图像,并在未知情同意的情况下进行数据处理。Clearview AI认为,人们在公开平台爬取的照片来自互联网公开可见的页面。因此,根据法律,这些数据被数据主体公开,无需单独同意;且Clearview AI处理数据行为是为了公共利益,具有合法利益。欧盟法域各执法机构对此保持一致的否定态度,认为数据在互联网上的公开可获取性,仅代表数据发布者基于特定目的允许数据公开,不改变其个人数据的属性,不意味着第三方可默认获得“用于面部识别”的同意,其用于监控行为的数据处理目的远超数据主体发布人脸信息时候的合理预期。

其次,就合法利益而言,各执法机构认为,Clearview AI作为一家私营企业,无限制地爬取公开渠道上的人脸数据并用于训练,侵犯个人隐私权益的程度,与企业的商业和金钱利益相比明显不成比例[12];其行为的目的、手段也不符合GDPR项下的处理原则和方式,给予Clearview AI的商业模式“极具侵入性”的严重评价。因此,Clearview AI无法通过利益平衡测试,不具有合法利益。

欧盟《人工智能法》(AI Act)采用基于风险的监管框架,将人工智能系统划分为不可接受风险、高风险、有限风险和最小风险四个层级,并对不同风险级别设置差异化合规义务。其第5条将通过从互联网或CCTV画面中无差别抓取人脸图像,以创建或扩展人脸识别数据库的做法列为“不可接受的风险”,予以全面禁止。在这一关键数据收集与建库环节,欧盟立法事实上否定了以 Clearview AI为代表的“无差别人脸抓取+人脸识别数据库”商业模式。

欧盟法域通过对数据处理核心原则的坚守和对敏感数据处理的最高要求,确保了在缺乏明确同意或法律基础的情况下,任何大规模、非透明的商业监控行为都无法获得合法地位,对隐私保护力度最大。

(2)加拿大

除了欧盟法域,加拿大也对Clearview AI的行为作出了否定性评价。加拿大联邦层面OPC(Office of the Privacy Commissioner of Canada)及三省隐私保护机构,根据加拿大《个人信息保护和电子文件法》(PIPEDA)及三省个人信息保护法规,从Clearview AI处理人脸信息是否具有合法基础、数据处理目的是否恰当来判断处理行为的合法性。加拿大执法与司法机关保持了相似了判断思路,都认为Clearview AI的行为未获得主体同意,并且处理目的也不适当。

其中,Clearview AI援引了“公开信息例外”[13]为其爬取公开人脸信息的行为开脱,认为其收集的人脸图像来自于互联网上的公开平台,因此,这些信息应被视为已公开的个人信息,无需获得个人的同意即可收集和使用。但加拿大监管机构对“公开例外”的抗辩进行了严格的限缩解释以保护个人隐私,认为该条的适用范围仅限特定来源,社交媒体等动态平台与传统出版物存在本质差异,不能类推适用;即使信息曾公开,但Clearview AI的行为超出个体的隐私预期,且未获得同意;最终目的是为了盈利,而非执法等,从而否定了行为的合法性[14]。

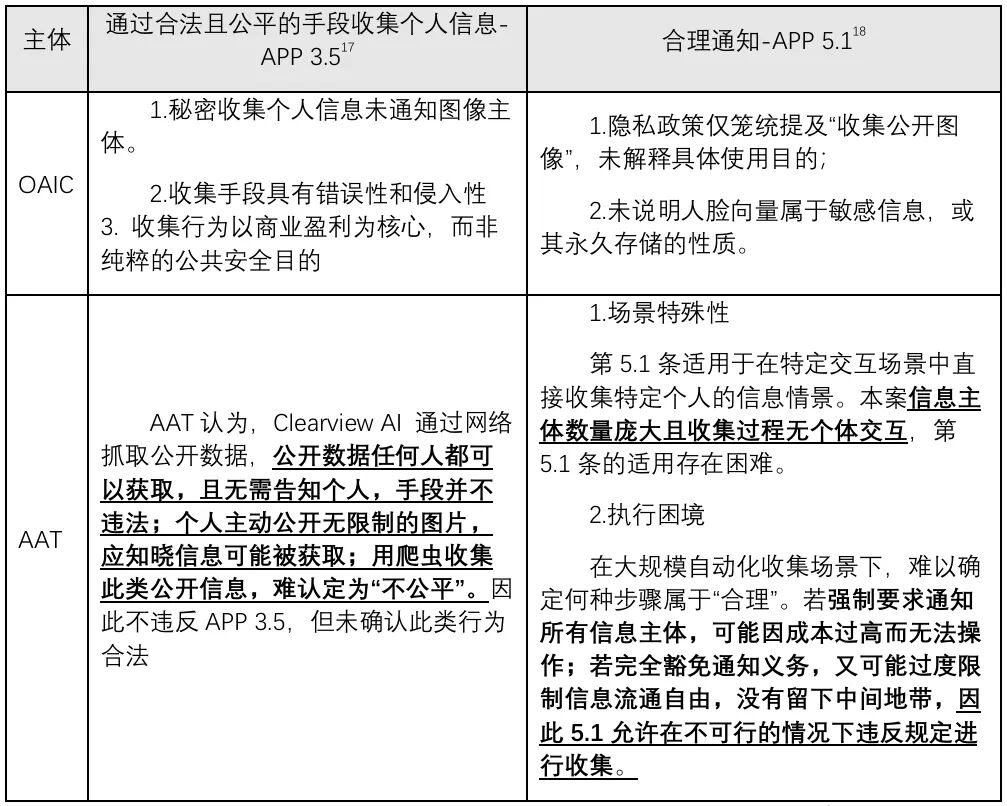

2、适当保护:澳大利亚

澳大利亚OAIC(Office of the Australian Information Commissioner)和司法机构在讨论Clearview AI行为违法性时,对Clearview AI的行为作出了全量的梳理。OAIC根据《1988年澳大利亚隐私法》和《澳大利亚隐私原则》(APP)的规定,针对Clearview AI的行为进行了分析,认为其未进行合理通知、未经同意收集敏感个人信息且没有通过合法且公平的手段收集个人信息,在后续披露的隐私政策中信息不准确,总体上违反了合规措施要求,因此违反了APP的第3.5、5.1、10.2和1.2条的内容[15]。Clearview AI对此表示不服,向行政上诉法庭(AAT)提起了上诉。

AAT保留了OAIC的部分观点,肯定了OAIC认定Clearview AI违反APP第3.3条和第1.2条的规定,并不违反其他义务。AAT与OAIC的主要分歧点在于(1)爬取公开的个人数据是否是合法、公平;(2)在技术不能的情况下,企业的告知义务应如何实现。[16]

点击可查看大图

对于第一个公开数据问题的分析,AAT赞同了OAIC关于爬取公开敏感个人信息需要获得同意的观点,但在分析APP第3.5条时却采取了一种技术中立的倾向,认为爬虫手段本身并不违法;其次,爬取的是公开数据,任何人访问该网页均可获取,数据主体应当对此存有预期,无“非法或不公平”情形。AAT分析的逻辑链仅集中在第3.5条的分析。

对于第二个告知义务的实现问题。AAT站在了技术不能的角度上思考,认为爬虫面向的对象数量庞大,告知和交互存在技术上实现的困境,法律不应强人所难,一定程度上放宽了对Clearview AI合规义务的判断。

总的来说,AAT以一种更中立的态度审查Clearview AI的行为,在法律解释上采取了更狭窄、更技术中立的路径,但结论并未放宽 Clearview的责任,总体上还是认定违反了APP的部分隐私要求。与澳大利亚AAT相比,英国 FTT在同期基于管辖权的考量撤销ICO对 Clearview AI的处罚(在后续被推翻)。但由于Clearview AI退出了上诉机制,OAIC的决定得以维持,Clearview AI仍然需要承担通知项下的责任。

3、宽松保护:美国

美国对人工智能训练数据中的公开个人数据的规制力度宽松,整体上以鼓励创新为主。在Clearview AI案件中,美国执法机关和司法机关对其的态度呈现明显的二元对立。美国执法机构仍然是Clearview AI最大的客户,迄今为止Clearview AI仍然在为美国的执法机构提供服务。在司法层面,Clearview AI在美国的案件都以和解结束,司法机关暂未对Clearview AI行为进行任何实体层面的评价。

不过,在ACLU v. Clearview AI案件中,法院的驳回动议暗含了否定的色彩。在案件中,Clearview AI认为抓取互联网公开照片不构成BIPA的未经同意收集生物识别信息,并提出了言论自由抗辩,主张其行为属于受保护的“言论”,而BIPA对其数据收集行为的限制构成对言论自由的违宪干预。对于公开例外的抗辩,法院认为,公开这一事实并不意味着任何人都可以随心所欲地处置它[19],只要Clearview AI提取了独一无二且可用于识别的面部数据,就构成BIPA范畴内的收集生物识别信息;对于言论自由的抗辩,法院承认Clearview的收集公开照片、生成人脸特征信息、提供数据库服务等行为涉及“表达性活动”(expressive activity),属于第一修正案保护范围。但法院强调,言论自由不保护所有数据收集和分析行为[20],Clearview AI的行为主要是为了商业目的,在利益衡量的天平上处于劣势,从而驳回了Clearview AI的抗辩。最终,双方达成了和解协议,Clearview AI被永久禁止向私营实体销售,服务范围限定为美国联邦、州和地方的执法机构及政府承包商;在伊利诺伊州当地,Clearview AI在五年内停止向州政府机构提供数据库服务,永久禁止向伊利诺伊州的任何个人或实体提供其数据库的访问权限,并且承诺删除数据。目前,Clearview AI在官网说明其满足美国13个州的居民的消费者关于要求访问、选择退出和/或删除其个人信息的请求。[21]

综上所述,爬取公开数据库中的人脸信息,并对其进行加工处理,创建人脸矢量库用以人脸识别这一行为,虽然各国的分析逻辑、侧重点及监管尺度不同,但在目前主流国家地区都属于违法行为,严重侵害了个人的隐私权利。

三、中国AI企业出海启示

(一)域外适用范围的扩张

(1)域外适用风险已成为AI企业的基础风险

在大模型训练普遍涉及公开图像、网络语料与用户行为日志的情况下,中国AI企业应默认训练集可能涵盖出海目的国各国居民数据。即便企业未在当地落地业务,只要模型能力对当地居民产生可识别、可联系、或可画像的实质影响,域外适用极可能被触发。模型训练、数据收集、标签加工等环节均需纳入跨法域的前置合规评估。

(2)为海外政府或执法机构提供技术能力,不能减轻企业的法律责任

为外国执法机构提供服务不能成为企业豁免适用的理由。企业向外国政府、执法或安全机构提供服务时,必须明确客户的政府身份并非合法的护身符,企业自身的商业活动仍须遵守所有私营部门的隐私义务,不能依赖客户的公共安全豁免来规避监管。

(3)跨国执法正在形成协同和连锁反应

无论是欧盟成员国的系列执法,还是英澳同期松绑Clearview AI义务,整体都体现出一种高度的监管协同性,其他国家先前的执法机关的态度很容易成为执法的参考和论证理由。不合规的风险具有全球性的叠加效应,一旦在欧盟等关键市场被认定违法,将迅速引发多国监管机构的类似执法和罚款,最终的成本将远远超过前期的合规投入。对于同时面向欧盟、澳洲、北美的中国企业而言,这意味着不合规成本呈指数级上升,远超通过事前建立体系性个人信息合规机制的投入。

(4)进入与退出海外市场的成本高度不对称

类似于Clearview AI断尾求生的行为不可复制,中国出海AI企业必须考虑到进入市场的问题。AI企业依赖当地合作伙伴生态,一旦因隐私违规导致API封禁、模型禁用、信用受损或被排除出合作生态,重新入场几乎不可能。模型需重训、供应链要重建,成本远高于前期合规。因此,应将隐私合规视为国际化布局的前置条件,而非额外成本或上线后再补救的问题。

(二)公开敏感个人信息用于训练的合法性判断

从Clearview AI系列执法案件来看,各司法辖区对公开敏感个人信息是否可以直接作为训练数据使用的法律认定已呈现高度一致的趋势:公开可见不等于合法可用,更不构成对高风险二次处理的默认同意。基于上述监管趋势,中国AI企业在全球化布局中应重点关注训练数据来源与用途的合法性边界,在涉及敏感个人信息时需要建立严格的合规机制。

(1)训练数据需要单独的合法性基础论证

企业应区分数据爬取行为与模型训练行为,对训练阶段的合法性基础进行独立论证。敏感个人信息的处理通常无法通过常规的抗辩,如公开性、合同必要性或正当利益进行兜底;除非能够提供明确同意或符合法定授权,否则无法满足合规要求。

(2)公开信息处理也需满足合理范围与目的兼容性要求

公开照片不等于对“识别性训练”的默认同意。即使是公开来源数据,也须审查是否超出数据主体合理预期,以及训练目的是否对个人构成高风险影响(如身份识别、监控、画像)。处理的目的与最小必要性必须经过严格审查。

(3)敏感数据的过滤与预处理是必要的合规步骤

企业应建立敏感数据识别机制,通过数据集清洗、分类过滤、特征脱敏(如模糊化、遮挡)、限制访问权限等方式降低训练风险。

(4)加强透明度与选择退出机制

即使处理公开数据,企业仍需履行透明度义务,履行公开数据处理说明、使用范围、对数据主体权利的响应机制等义务,为数据主体提供删除或退出渠道,尤其是在面向海外用户提供服务的场景中,需要注意当地隐私法律要求。

(5)防范“毒树之果”避免非法训练导致的风险链条扩散

如训练集被认定非法,模型本身及其所有下游应用都可能被推定为违法。企业应从源头管理数据来源与记录,以证明训练过程合法。

(三)技术中立并不豁免个人信息保护义务

Clearview AI系列案件显示,各司法辖区在评估人工智能企业的法律责任时,大多明确否定了“技术中立”作为豁免理由的可能性。这意味着,在AI场景下,监管机构通过考虑AI服务提供者的能力、处理目的、方式、影响等因素,综合判断AI服务提供者主体的责任。

(1)技术中立不等于责任中立:只要企业对数据目的、来源、算法参数、模型能力具有决策力,就构成数据处理者

监管机构普遍认为,AI服务提供者对模型训练、数据规模与算法结构具有自主控制能力,因此必须承担全面的个人信息保护和风险防控责任。因此,AI企业应充分认识到,一旦选择构建、训练和部署具备强个人识别能力的模型,即自动承担相应的法律与伦理风险。

(2)企业需对可预见的滥用与外溢风险负责

AI模型可用于监控、识别、画像、执法辅助等高风险用途,企业应在设计阶段预见滥用可能,设置权限控制、用途限制、访问审计与模型输出约束机制。

(3)出海企业应建立端到端的责任链:从训练、部署到客户使用场景

在实务层面,企业需提前开展多维度评估,包括个人权利影响评估、算法与模型能力的伦理评估、以及对潜在偏见、歧视和滥用风险的分析论证。在此基础上,明确模型的使用边界、识别机制及访问控制机制,确保模型输出和应用场景均处于可解释、可追责的框架之中。

四、结语

梳理Clearview AI系列案件,全球隐私监管在Clearview AI案件上形成了共识,各国隐私法域外适用正在扩张,敏感个人数据公开可见不再等同于合法可用,任何涉及大规模、系统性地收集和利用敏感个人信息的商业模式,如果违背数据主体的合理预期且未经数据主体同意,其处理活动将从根本上被判定为非法。这提示中国AI企业,在进行产业布局和产品研发时,必须更加前置性地开展风险识别与合规评估,通过最小化处理、目的限制、影响评估等机制防范潜在法律风险,以确保在日益严格的全球监管环境下实现可持续、可规模化的出海发展。

[注]

[1]Clearview AI, https://www.clearview.ai/(最后访问日期:2025年12月4日)。

[2]Ryan Mac, Caroline Haskins & Logan McDonald, Clearview’s Facial Recognition App Has Been Used By The Justice Department, ICE, Macy’s, Walmart, And The NBA, BuzzFeed news(28 February 2020), https://www.buzzfeednews.com/article/ryanmac/clearview-ai-fbi-ice-global-law-enforcement(最后访问日期:2025年12月11日)。

[3]Clearview AI, https://www.clearview.ai/faq?utm(最后访问日期:2025年12月10日)。以上各州对执法部门使用面部识别技术有严格的限制的州为:缅因州、佛蒙特州、蒙大拿州和马萨诸塞州。

[4]由于英国脱欧后虽不再适用欧盟《通用数据保护条例》(GDPR),但英国在《2018年数据保护法》(Data Protection Act 2018)基础上引入并延续了原GDPR的核心结构,形成所谓《英国通用数据保护条例》(UK GDPR),两者保持高度一致。因此,在Clearview AI系列案件中,将欧盟法域和英国法域作为同一法律传统下的延续性制度进行并行讨论,以便在统一框架下呈现其对跨境数据处理与海外企业的共同执法思路。

[5]The Information Commissioner v. Clearview AI Inc. [2025] UKUT 319, para. 133.

[6]Clearview AI Inc. v. Information and Privacy Commissioner for British Columbia [2024] BCSC 2311, para.88

[7]澳大利亚《1988年隐私法》5B澳大利亚联系

(1) 本法适用于一个组织的行为或实践,如果:

(a) 该行为或实践是在澳大利亚及其外部领地之外完成或参与的;并且

(b) 该组织是一个澳大利亚组织;或

(c) 该组织是一个小企业经营者,且该行为或实践与保存在澳大利亚或外部领地内的个人信息记录相关。

在2022年修改后,删除了第(c)项的规定。换言之,仅需满足要件(1)在澳大利亚开展业务即可落入《隐私法》的规制范畴。

[8]参见ACLU v. Clearview AI, CASE NO.20 CH 4353(2021), MEMORANDUM OPINION AND ORDER Denying Defendant's Motion to Dismiss,https://www.aclu.org/cases/aclu-v-clearview-ai(最后访问日期:2025年12月11日)。

[9]Clearview AI, FAQ, at https://www.clearview.ai/faq(最后访问日期:2025年12月4日)。

[10]Lydia Emmanouilidou, How A Shady US AI Company Dodged Fines and Defied Regulators Across Europe, https://wearesolomon.com/mag/format/investigation/clearview-how-a-shady-us-ai-company-dodged-fines-and-defied-regulators-across-europe/(最后访问日期:2025年12月4日)。

[11]Noyb, Criminal complaint against facial recognition company Clearview AI,

https://noyb.eu/en/criminal-complaint-against-facial-recognition-company-clearview-ai(最后访问日期:2025年12月4日)。

[12]National Commission for Computing and Liberties, Délibération SAN-2022-019 du 17 October 2022(20 October 2022), https://www.legifrance.gouv.fr/cnil/id/CNILTEXT000046444859(最后访问日期:2025年12月11日)。

[13]《个人信息保护和电子文件法附属法规》(Regulations Specifying Publicly Available Information)

第1条:以下个人信息被指定为已公开信息:

(a) 由个人的姓名、地址和电话号码,以及雇主名称组成的个人信息,这些信息是在个人就业、商业或专业活动的背景下收集、使用或披露的;

(b) 出现在根据法定授权收集的登记簿中,并且国会或省级立法机关的法案授权公众查阅的个人信息;

(c) 出现在可供公众查阅的司法或准司法机构的记录或文件中的个人信息;

(d) 包含在可供公众查阅的出版物(包括杂志、书籍或报纸)中的个人信息,且个人信息的收集、使用或披露与信息出现在出版物中的目的直接相关。

[14]Office of the Privacy Commissioner of Canada, Joint investigation of Clearview AI, Inc. by the Office of the Privacy Commissioner of Canada, the Commission d’accès à l’information du Québec, the Information and Privacy Commissioner for British Columbia, and the Information Privacy Commissioner of Alberta, https://www.priv.gc.ca/en/opc-actions-and-decisions/investigations/investigations-into-businesses/2021/pipeda-2021-001/ (最后访问日期:2025年12月11日)。

[15]OAIC, Clearview AI breached Australians’ privacy, https://www.oaic.gov.au/news/media-centre/clearview-ai-breached-australians-privacy (最后访问日期:2025年12月11日)。

[16]Clearview AI Inc. v. Australian Information Commissioner, [2023] AATA 1069 (Austl. Admin. App. Trib.). 澳大利亚行政上诉法庭(AAT)《Clearview AI Inc.诉澳大利亚信息专员案》(AATA 2023/1069)

[17]APP第3.5条:一个APP实体必须仅通过合法和公平的方式收集个人信息。

[18]APP第5.1条:在APP实体收集一个个体个人信息之时或之前,或者如果不可行,则在收集后尽快,该实体必须采取在当时情况下合理的措施(如果有的话):

(a) 将第5.2款提及的在当时情况下合理的事项告知该个体;或

(b) 以其他方式确保该个体知晓任何此类事项。

[19]ACLU v. Clearview AI, CASE NO.20 CH 4353(2021), MEMORANDUM OPINION AND ORDER Denying Defendant's Motion to Dismiss, p.11.

[20]参见注19,ACLU v. Clearview AI, p.9.

[21]Clearview AI, https://www.clearview.ai/privacy-policy,(最后访问日期:2025年12月4日)。