当AI“拟人化陪伴”进入金融场景:金融机构如何应对《人工智能拟人化互动服务管理暂行办法》的个人信息保护新规

当AI“拟人化陪伴”进入金融场景:金融机构如何应对《人工智能拟人化互动服务管理暂行办法》的个人信息保护新规

引 言

2026年4月10日,国家互联网信息办公室联合国家发展改革委、工业和信息化部、公安部、国家市场监管总局正式发布《人工智能拟人化互动服务管理暂行办法》(以下简称《办法》),将于2026年7月15日起施行。作为我国首部专门规范“AI拟人化情感互动服务”的部门规章,《办法》并非凭空创设,而是在《网络安全法》、《数据安全法》、《个人信息保护法》及《未成年人网络保护条例》等上位法基础上,针对特定场景作出的精细化、场景化规制。

从金融合规视角看,《办法》虽聚焦情感陪伴、心理支持等场景,但随着金融科技向智能化、情感化、拟人化发展,金融业务与AI拟人化互动的边界日趋模糊。金融机构一旦引入或开展此类服务,即可能落入《办法》规制范畴,需履行更严格的个人信息保护义务。本文结合金融业务特性,解析《办法》适用边界、个人信息保护核心义务,并提出可落地的合规应对方案。

一、《办法》适用范围:金融业务的触发场景判断

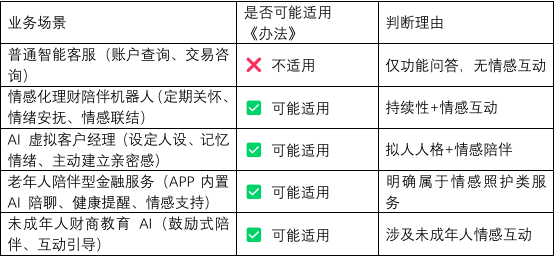

《办法》第二条规定:利用人工智能技术,向境内公众提供模拟自然人人格特征、思维模式和沟通风格的持续性的情感互动服务,适用本办法。提供智能客服、知识问答、工作助手等服务,不涉及持续性的情感互动的,不适用。因此“持续性”+“情感互动”特征成为判断是否适用《办法》的关键标准。金融机构典型场景适用判断如下:

点击可查看大图

结论:金融机构 AI 应用若超出纯功能问答,提供情绪价值、建立情感连接、模拟人格陪伴,即可能构成 “拟人化互动服务”,受《办法》监管。

二、金融机构个人信息保护:《办法》新增核心义务

《办法》在《个人信息保护法》基础上,针对拟人化互动提出更严格、场景化的个人信息保护要求,金融机构需重点履行以下义务:

1. 敏感个人信息模型训练限制 (第16条)

禁止将用户敏感个人信息的交互数据用于模型训练,除非取得用户单独同意。因此,金融机构在与客户用AI的情感互动中透露的财务状况、投资偏好、心理焦虑、家庭负担等信息,很可能构成敏感个人信息。金融机构不得默认将这些数据用于AI模型训练,必须单独弹窗告知并获取明确同意,不得捆绑在开户协议或服务条款中。

2. 未成年人数据特殊保护(第14、17条)

禁止向未成年人提供虚拟亲属、虚拟伴侣等虚拟亲密关系服务;向不满14周岁未成年人提供服务,必须取得监护人同意;强制上线未成年人模式,支持时长限制、角色屏蔽、消费限制等;每年至少一次未成年人个人信息合规审计。如金融机构面向未成年人推出财商教育、零花钱管理等AI陪伴服务,需严格按此执行。目前部分银行推出的“儿童银行卡”配套AI助手,需重新评估是否触发《办法》。

3. 极端情绪识别与干预义务(第13条)

AI识别到用户存在自残、自杀等极端情绪时,必须主动干预,并及时联络监护人或者紧急联系人。理财亏损、投资波动易引发用户极端情绪,相关情绪、健康信息属于敏感个人信息,需按最高标准保护。因此金融机构需要建立极端情绪识别算法,干预流程、紧急联系人机制联动机制。这将涉及对用户情绪状态等健康信息的收集与处理,属于敏感个人信息,需满足更高保护标准。

4. 数据删除与便捷退出机制(第16、19条)

用户享有交互数据复制、删除权,机构需提供便捷操作入口,不得设置障碍阻碍用户退出拟人化互动服务。因此,金融机构需在APP内设置明确的“删除情感互动记录”“退出AI陪伴模式”功能。这与金融数据留存义务(如反洗钱数据保存5年)可能存在冲突。

三、金融机构合规落地实操建议

基于上述分析,我们建议金融机构从以下方面开展合规工作:

建议一:全面开展场景排查与合规认定

梳理现有及规划中的AI应用,区分“纯功能型客服”与“情感陪伴型服务”;

对落入《办法》范围的服务,按第22条要求完成安全评估,并向省级网信部门提交评估报告。

建议二:建立情感互动数据专项治理机制

将情感互动中收集的用户情绪、心理状态、亲密关系信息等,列为最高级别敏感数据;

实行单独授权+分类存储+访问控制+定期清理全流程管理;

对用于模型训练的数据,必须取得单独同意,并完整记录授权日志。

建议三:完善未成年人保护与监护人同意流程

严禁为未成年人提供虚拟亲密关系类AI服务;

部署不可绕过的未成年人模式,并与银行原有的未成年人账户体系打通;

委托第三方专业机构开展未成年人个人信息合规审计,留存报告备查。

建议四:嵌入极端情绪预警与干预体系

部署情绪识别算法,避免过度采集用户隐私信息;

建立 AI、人工客服、心理援助、紧急联系人四方联动干预机制;

在隐私政策中明确告知情绪数据的收集、使用与干预规则。

建议五:化解《办法》与金融监管规则冲突

《办法》要求用户可删除交互数据,但《反洗钱法》要求交易记录保存5年。因此,金融机构应该注意数据分类隔离——情感互动数据独立存储、独立管理,用户可自主删除;交易数据按反洗钱等要求法定留存,两类数据互不影响。

四、法律风险与合规展望

《办法》第三十条规定,违反个人信息保护规定的,最高可处20万元罚款,并可被责令停止相关服务。对金融机构而言,停服风险直接影响业务连续性,合规代价远高于罚款。此外,国家网信办明确将推进人工智能沙箱安全服务平台建设(第28条),金融机构可主动接入沙箱,在受控环境中测试 AI 情感陪伴服务,提前验证合规性、降低试错风险。

五、结语

当金融机构AI从“工具型问答”升级为“人格化陪伴”,就必须直面新规带来的个人信息保护挑战。建议金融机构立即启动合规评估,在2026年7月15日《办法》施行前,完成制度流程、技术系统、法律文件的全面整改,保障业务创新与合规安全并行。