从某头部电商平台诉Perplexity案看中国AI Agent的合规红线:治理必要性与制度因应

从某头部电商平台诉Perplexity案看中国AI Agent的合规红线:治理必要性与制度因应

引 言

2026年3月9日,美国加利福尼亚北区联邦地区法院的一纸初步禁令[1],再次将人工智能智能体(AI Agent)的法律边界问题推至风口浪尖。某头部电商平台诉Perplexity案[2]不仅揭示了AI技术在商业化落地过程中与平台方产生的激烈冲突,更向全球AI产业释放出明确信号:技术自主性不等于法律豁免权,当代码闯入他人领地,法律的红线依然清晰可辨。

对于中国AI Agent企业而言,此案的警示意义远超案件本身的法律结论。原因在于,中国的法律框架对“未经授权访问计算机系统”的规制,在某些层面比美国更为严格。若中国企业仅关注美国《计算机欺诈与滥用法案》(CFAA)的判例逻辑,而忽视国内《中华人民共和国刑法》《中华人民共和国网络安全法》《中华人民共和国数据安全法》《中华人民共和国反不正当竞争法》《中华人民共和国个人信息保护法》(以下简称《刑法》《网络安全法》《数据安全法》《反不正当竞争法》《个人信息保护法》)乃至平台规则的合规要求,极有可能陷入“美国诉讼未至,中国处罚先行”的窘境。

本文将从中国法律实务视角重新审视该案的核心争议,系统论证中国AI Agent治理的必要性,剖析现行法律框架的适配性挑战,并提出分层分类的治理思路与具体合规建议,以期为中国AI Agent企业的合规发展提供务实指引。

一、案件复盘:一场关于“访问权限”的攻防战及其中国法映射

在展开中国法分析之前,有必要简要复盘本案的关键事实与法律逻辑,以作为后续论证的基础。

本案中,Perplexity开发的Comet浏览器集成了“代理型AI”功能,能够模拟人类用户行为,并在获得用户许可后,自动完成在该头部电商平台上的浏览、下单等操作。该平台的《使用条件(Conditions of Use)》[3]明确要求AI代理必须通过特定的“用户代理字符串”标识身份,即“Agent/[代理名称]”,不得伪装成人类用户,也不得规避平台设置的技术屏障。

然而,根据本案起诉状[4],Perplexity的Comet被指控故意伪装成某浏览器厂商的标识,隐瞒其AI代理身份。该平台发现后立即设置技术屏障,Perplexity却在24小时内便通过软件更新成功绕过。该平台在多次书面警告无果后提起诉讼,法院于2026年3月9日批准初步禁令,禁止Perplexity继续使用AI代理访问该平台受保护的计算机系统。法院的核心裁判逻辑是“用户个人的同意,并不足以授权第三方持续访问平台系统,尤其是在平台已经明确撤销该访问权限之后”。这一逻辑,与中国司法实践对“超越授权访问”[5](最高人民检察院第36号指导性案例)的认定高度契合。

在江苏省常州市天宁区检察院办理的一起涉AI技术非法获取数据案[6]中,法院明确认定,行为人通过技术手段破解加密算法,突破计算机信息系统安全防护措施,在未经许可下进入他人计算机信息系统,并长期伪造请求获取非公开数据,构成非法获取计算机信息系统数据、非法控制计算机信息系统罪。该案中,被告单位开发了AI智能互动平台。该平台在未获得某社区电商平台App授权的情况下,通过计算Shield加密值绕过该App与后端服务器之间的加密算法,伪造请求获取了该App内的用户昵称、userID、noteID、笔记等数据;之后,该公司利用爬取的数据,通过技术手段破解了该App的私信接口,使其平台付费商户能够绕过该电商平台客户端的私信系统,直接向该App用户发送私信,从而实现为付费商户投放广告的目的。该行为违法所得达600余万元,相关责任主体最终被判处刑罚。

两案对比可见,常州案属未经授权的非法入侵,Perplexity则系在用户授权下代理操作,但以伪装标识违反平台使用条件。二者行为外观虽有无授权与有授权但违规之别,却在超越授权访问这一法理上高度共通:常州案自始无授权,Perplexity则于平台明示拒绝后仍以伪装手段持续访问。两案共同揭示,超越授权与未经授权同为中国法所禁止的侵入行为。

二、中国AI Agent技术特征与治理必要性

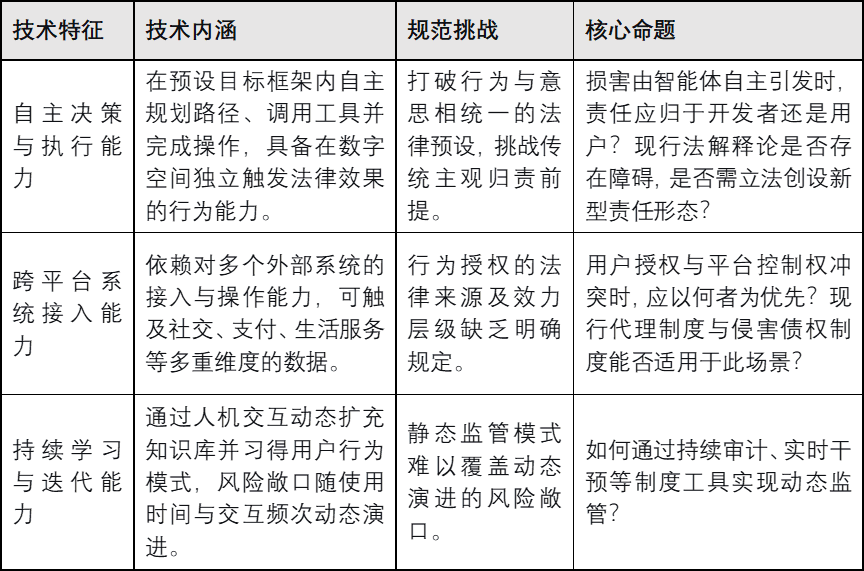

(一)AI Agent的技术特征

AI Agent区别于传统大语言模型的本质特征,在于其实现了从信息处理到行为执行的职能跨越。2025年被业界称为AI Agent元年[7],国务院同年印发的《关于深入实施“人工智能+”行动的意见》[8]重点将智能体正式纳入国家级政策文件。这一跨越使人工智能的法律风险从内容安全延伸至行为安全,进而对以自然人行为为核心构建的传统法律责任体系形成结构性挑战。与传统大语言模型相比,AI Agent的核心技术特征主要体现在三个维度:一是自主决策能力,这一特征对传统归责逻辑形成直接冲击;二是跨平台接入能力,这一特征使既有授权规则的适用边界趋于模糊;三是持续学习能力,这一特征对静态监管模式构成适应性挑战。具体详见下表的分析。

点击可查看大图

(二)AI Agent治理必要性的三重逻辑

1. 风险逻辑:从内容安全到行为安全

AI Agent的广泛应用使人工智能风险从传统的生成内容安全扩展至自主执行行为安全,智能体行为边界的确定性与可靠性由此成为核心关切。这一风险结构的变迁,具体体现在以下维度:

其一,数据安全风险。高度自主决策功能依赖用户开放足够的数据访问权限,这意味着用户本地存储的文件、数据、密钥等均处于风险不确定状态。例如,近期OpenClaw应用已出现误删电子邮件、重要文档等技术故障,若用户未能正确卸载,残留文件仍会对个人计算机产生安全威胁。国家互联网应急中心[9]、中国互联网金融协会[10]等部门已陆续发布风险提示,提醒公众重视安全风险,审慎安装使用相关应用。

其二,隐私保护挑战。当智能体自主运作时,“谁来控制个人信息?如何界定使用目的或征得同意?”成为亟待回应的问题。智能体以自主行动完成代理任务的运作模式,使得《个人信息保护法》框架下的“知情同意”“目的限制”等原则在实操层面面临适配性挑战。

其三,行为边界的法律模糊性。智能体的功能定位是“私人定制”的专属服务,需获取大量用户个人信息用于训练,以形成契合用户使用习惯的信息服务模式,但这也使得《个人信息保护法》中的“最小必要原则”面临被虚置的风险。由于智能体的核心作用是为用户提供全方位的便捷化服务,实践中难以界定哪些信息属于实现其功能所必要的范畴。

2. 制度逻辑:现行法律框架的适配性挑战

中国政法大学、西南政法大学、华东政法大学等单位联合发布的《人工智能法治研究十大议题(2026)》[11]明确将“智能体的行为边界、授权机制与竞争治理”列为首要议题,指出当前智能体技术快速落地应用,自主决策、交互执行能力持续升级,随之引发的行为边界模糊、授权机制缺失、市场竞争失序等问题日益凸显。具体而言,现行法律框架面临以下适配性挑战:

一是“数据控制”与“数据利用”的规制重心错位。现行刑法明显侧重于规制数据处置上游行为,即非法获取、编造、传播、破坏数据等行为,而对于数据处置下游行为中非法利用数据行为的规制则相对薄弱。华东政法大学刘宪权教授指出,在生成式人工智能的应用场合,“数据控制”行为的合法性增强,而“数据利用”行为的危害性攀升,数据犯罪的刑法规制重点应由侧重规制非法控制数据行为,转向侧重规制非法利用数据行为[12]。

二是“知情同意”原则的适用困境。智能体的自主行动特性,使得《个人信息保护法》以“个人控制”为核心构建的制度框架面临挑战。当智能体代表用户自主决策时,传统的“告知-同意”机制面临运行困境,用户难以对每一次数据的收集和使用行为进行实时控制。

三是责任配置的模糊性。智能体高度自主的决策功能可能带来损害,但责任在开发者、部署者与用户之间的归属难以界定,现行侵权责任规则也难以完全适配这一新型场景。

3. 产业逻辑:野蛮生长亟需规范发展

2025年,国家网信办部署开展“清朗·整治AI技术滥用”专项执法行动,第一阶段累计处置违规小程序、应用程序、智能体等AI产品3500余款,清理违法违规信息96万余条,处置账号3700余个。[13]这一数据折射出AI产业在快速发展过程中伴生的合规乱象。

从监管实践来看,典型的违规行为主要包括:未获得相关个人信息主体的合法授权即提供AI换脸、AI拟声功能;提供可能诱导用户沉迷或包含擦边低俗内容的对话服务;生成侵犯他人名誉权、隐私权等合法权益的违规信息。

AI Agent作为AI技术的最新形态,若缺乏明确的合规指引,同样可能陷入上述合规困境。产业界亟需清晰的规则框架,以避免野蛮生长引发的系统性风险,推动行业实现高质量发展。

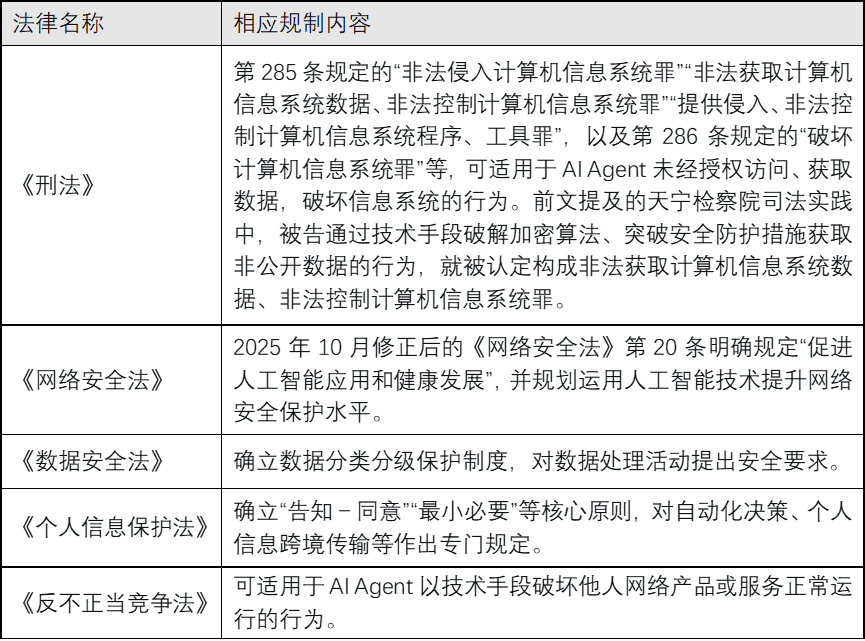

三、中国AI Agent治理的制度基础:现行法律框架的适用与演进

(一)现行法律规范体系

在中国现行法律框架下,可适用于AI Agent的规范主要包括以下层级:

1. 法律层面

点击可查看大图

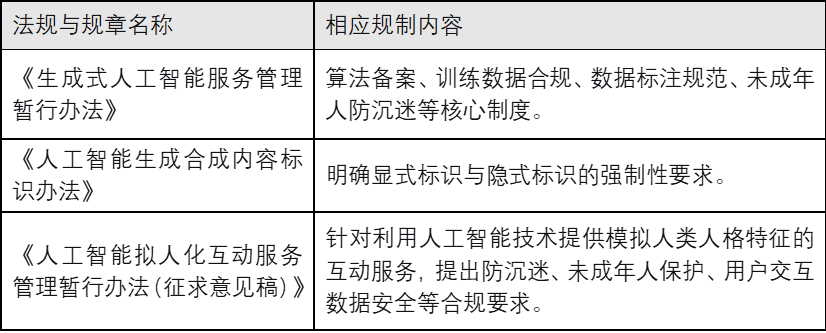

2. 行政法规与部门规章层面

点击可查看大图

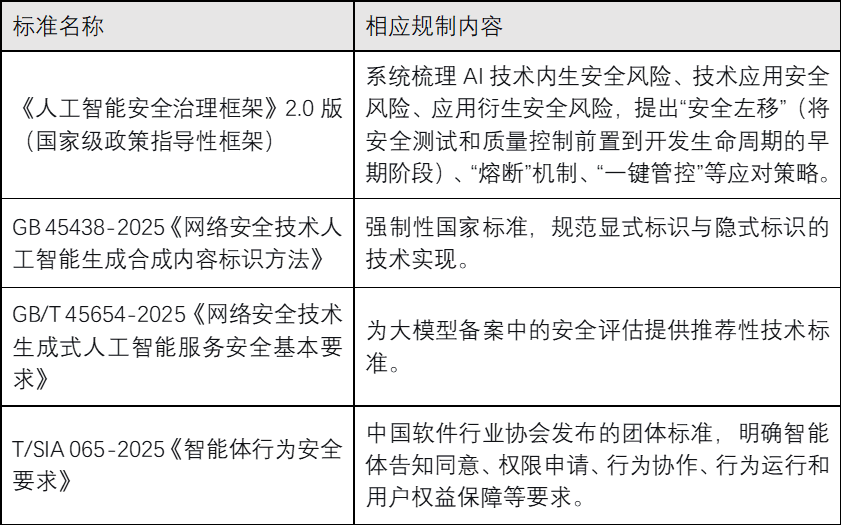

3. 标准规范层面

点击可查看大图

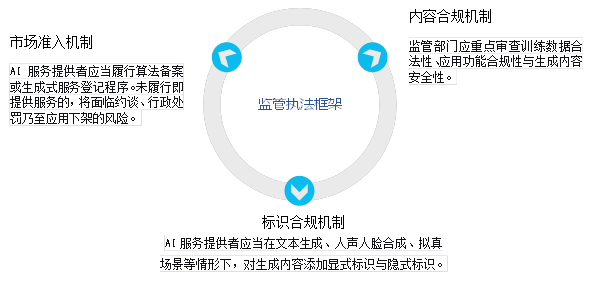

(二)监管执法框架

中国对AI技术的监管采取“网信部门统筹、行业主管部门协同”的体制。国家网信办作为主要监管部门,通过以下机制实施监管:

点击可查看大图

四、中国AI Agent治理思路:分层分类与敏捷治理

面对AI Agent技术快速迭代与风险复杂化的双重挑战,中国学界与实务界正探索符合国情的治理路径。结合近期研究成果与政策动态,中国AI Agent治理思路可概括为以下框架:

(一)基本原则:以人为本与智能向善

应对智能体治理风险,必须始终坚持“以人为本、智能向善”的基本原则,并强调采取适合智能体特点的“敏捷治理、多元共治”模式。这一原则要求:

第一,以用户权益保护为中心。AI Agent的治理应立足于保障用户的数据安全、隐私权、知情权与选择权,而非单纯的技术管控;

第二,促进技术创新与风险防控的平衡。治理模式需在保障安全的前提下,为AI Agent的发展预留创新空间,避免采取“一刀切”式的过度规制。

(二)治理模式:敏捷治理与动态调整

治理模式需在原有大语言模型治理基础上进行三点调整:

第一,从内容安全延伸到行为安全。不仅要管控文本内容,更要确保智能体执行动作的行为边界清晰。例如,对于资金流出、安全配置修改等风险极高的行为,可禁止智能体自主执行;对于邮件回复等行为,则需由用户进行最终确认。

第二,从静态边界管理转向动态边界管理。随着技术迭代和安全场景的拓展,治理模式需同步升级。可根据技术发展、产业动态等因素适时调整负面清单。

第三,从单纯的风险防控转向可信交互。只有建立起用户对智能体的信任,用户才敢于授权其处理酒店、机票预订等关键任务。

(三)治理路径:技术、监管与社会三管齐下

1. 技术层面:以安全可控为底线

通过技术架构确保智能体行为可验证、可干预、可追溯。在权限配置层面,落实最小权限原则,按任务节点拆分权限,禁止全能型Agent,关键环节应由人主导,契合《个人信息保护法》第6条规定;在安全监控层面,部署安全智能体,实时监测异常行为并阻断;在运行环境层面,构建安全可信执行环境,防范提示词注入、视觉对抗攻击、数据投毒等新型攻击。

2. 监管层面:以权责清晰为基础

通过制度设计明确各方责任,为创新提供秩序轨道。在授权边界层面,区分用户授权与平台授权,建立分级授权机制,对敏感操作设置更高的授权要求;在监管制度层面,实行分级分类监管,对高风险领域禁止端侧智能体或设置严格准入标准,对一般领域则制定行业针对性规范;在责任配置层面,明确开发者、部署者、用户之间的责任分担,完善拒不履行信息网络安全管理义务罪等罪名构成要件。

3. 社会层面:以多元共治为导向

技术治理与法律规制之外,社会协同参与是治理体系的重要补充。在公众认知层面,应普及智能体基本原理与使用规范,增强用户风险意识,形成合规产品的市场选择机制;在行业自律层面,鼓励制定团体标准与行业公约,构建“法律底线+行业标准”的双层规范体系;在争议解决层面,搭建在线争议解决平台,引入多方主体参与纠纷处理;在社会监督层面,要求服务提供者定期披露运行情况与安全事件记录,以透明度倒逼合规管理水平提升。

五、AI Agent企业的合规建议:从“事后补救”到“事前嵌入”

该头部电商平台诉Perplexity案给中国企业提供的制度性启示在于,合规不应定位于事后的补丁式修补,而应从技术架构设计之初就嵌入法律思维。基于我国现行法律规范体系,结合国内监管实践与最新政策动态,以下拟从技术设计、平台交互、数据治理、内部组织四个维度,系统构建AI Agent企业的合规义务体系。

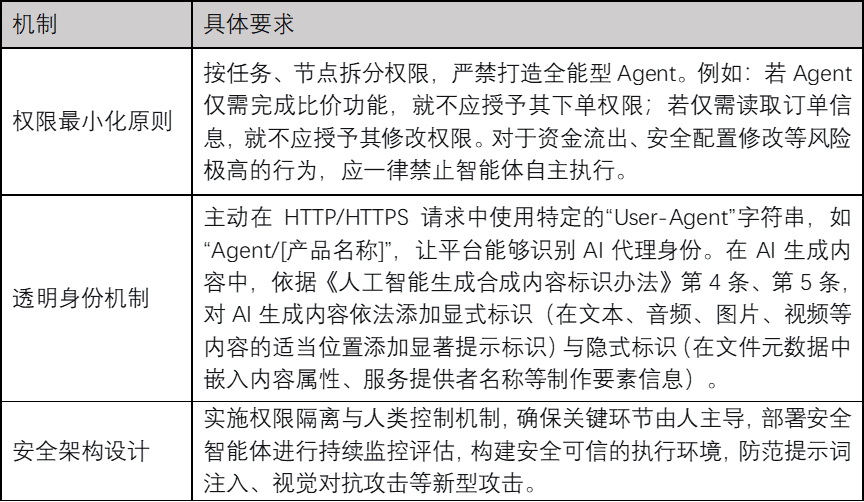

(一)技术设计层面:践行权限最小化与透明身份机制

技术设计层面的合规要求,本质上是将法律规范中的实体性义务转化为算法系统的程序性约束,具体体现为权限配置与身份识别两个核心命题。前者旨在落实《个人信息保护法》的最小必要原则,后者则服务于《互联网信息服务深度合成管理规定》《人工智能生成合成内容标识办法》关于生成内容标识与可追溯的强制性要求。

点击可查看大图

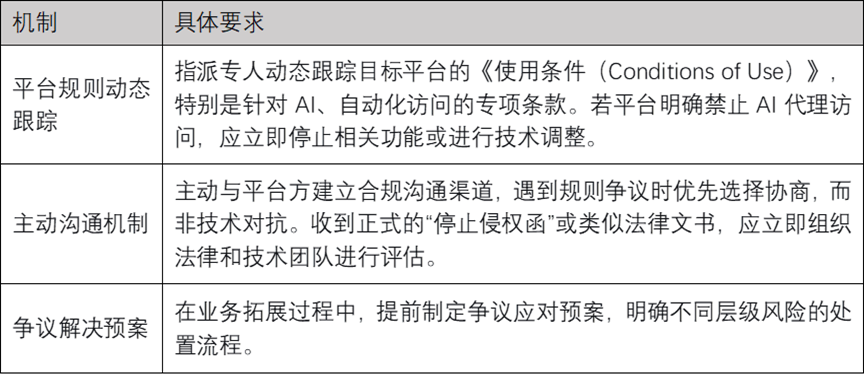

(二)平台交互层面:建立规则遵从与主动沟通机制

平台交互层面的合规要求,根源于AI Agent作为第三方应用与平台之间形成的法律关系。该关系的法律性质可界定为合同关系与竞争关系的复合形态,企业在此层面面临的主要风险包括违反平台服务协议所引发的违约责任,以及不当自动化访问所可能构成的不正当竞争等。具体制度安排如下表所示。

点击可查看大图

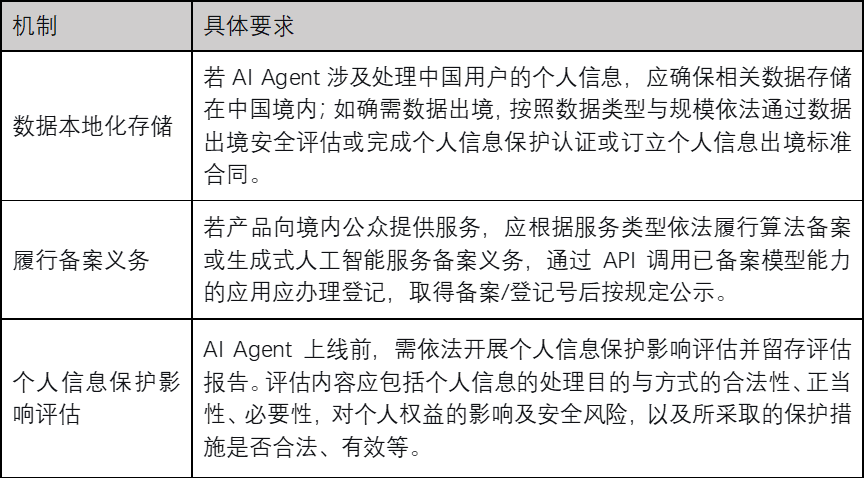

(三)数据合规层面:严守出境与存储备案红线

我国数据治理规范体系以《中华人民共和国网络安全法》《中华人民共和国数据安全法》《中华人民共和国个人信息保护法》为三大支柱,共同构建了涵盖数据本地化、出境安全评估、个人信息保护影响评估、算法备案的层级化义务框架。AI Agent企业在此维度面临的规范要求,具有强制性、复合性与程序性三重特征。具体制度安排如下表所示。

点击可查看大图

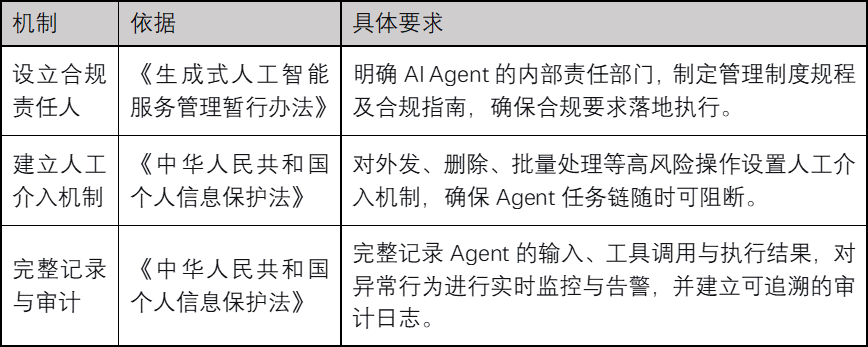

(四)内部治理层面:明确责任与审计机制

内部治理层面的合规要求,旨在将前述技术、交互、数据等维度的规范要求内化为企业的日常管理制度。该层面的制度设计直接决定了合规要求能否从规范文本转化为实践行动,其核心在于解决责任归属与监督机制两个基本问题。具体制度安排如下表所示。

点击可查看大图

六、结语:以合规设计护航AI Agent创新

该头部电商平台诉Perplexity案,是AI Agent时代来临之际,技术创新与平台秩序碰撞的一个缩影。美国法院的初步裁决揭示了司法系统在平衡技术发展与数据安全时的立场——创新不能成为突破法律底线的理由,技术自主更不是违法入侵的通行证。

对于中国企业而言,此案的价值已超越美国判例的参照意义。国内《刑法》《网络安全法》《数据安全法》《反不正当竞争法》以及日益细化的生成式人工智能监管规范,共同构筑了严密的法律规制体系。Perplexity式行为若发生在中国,可能面临刑事责任、行政监管、民事诉讼的三重法律风险。

然而,法治的完善并非要扼杀创新,恰恰相反,真正的技术创新,往往是在规则框架内探索最大可能性的艺术。正如《人工智能法治研究十大议题(2026)》所揭示的,人工智能法治研究的核心使命在于“服务实需求”,即在保障安全的前提下,为人工智能产业发展提供法治指引。

面对AI Agent这一新兴技术形态,中国正在探索一条“敏捷治理、多元共治”的治理道路——从内容安全延伸到行为安全,从静态管理转向动态调整,从风险防控升级为可信交互。这条道路既借鉴国际经验,又立足中国国情;既防范技术风险,又释放创新活力。

对于AI Agent企业而言,合规不应被视为发展的枷锁,而应内化为产品的基因。只有将法律思维嵌入技术架构的每一个环节,才能在日趋复杂的全球监管环境中行稳致远,避免重蹈Perplexity的覆辙,在AI时代真正实现“向善”与“创新”的双赢。

[注]

[1] No. 3:25‑cv‑09514, Order Granting Motion for Preliminary Injunctive Relief (N.D. Cal. Mar. 9, 2026).

[2] 3:25-cv-09514-MMC (N.D. Cal. Mar. 9, 2026).

[3] Technical Requirements. Agents must:

i.In all HTTP/HTTPS requests, identify that the request is from an Agent and disclose the name of the Agent by including the following in the request's user agent string:

"Agent/[agent name]"

ii.Not conceal or obfuscate that any access, use, or interactions are from an Agent, such as by (a) mimicking the speed or pattern of human keystrokes, page navigation, or other interactions or (b) completing or circumventing CAPTCHAs or other measures intended to distinguish computers from humans.

iii.Respond truthfully to any question or prompt seeking to determine if interactions are coming from a human or a computer.

……

[4] 3:25-cv-09514-MMC (N.D. Cal. Mar. 9, 2026).

[5] 最高人民检察院第36号指导性案例“卫某等人非法获取计算机信息系统数据案”明确确立:“超出授权范围使用账号、密码登录计算机信息系统,属于侵入计算机信息系统的行为”,https://bjhdfy.bjcourt.gov.cn/article/detail/2026/01/id/9159078.shtml。

[6] 参见:《斩断非法获取数据的暴利链条》,https://www.spp.gov.cn/spp/llyj/202506/t20250603_697192.shtml。

[7]https://www.bjnews.com.cn/detail/1756281482168324.html.

[8]https://www.gov.cn/gongbao/2025/issue_12266/202509/content_7039598.html.

[9]https://news.cctv.com/2026/03/23/ARTIV4GZTWha5JA6yTvgmSo7260322.shtml.

[10]https://news.cctv.com/2026/03/15/ARTImcbDCld45EZBKEDQajfw260315.shtml.

[11]http://www.legaldaily.com.cn/index/content/2026-03/27/content_9364275.html.

[12]https://news.qq.com/rain/a/20241115A04O0F00.

[13]https://www.cac.gov.cn/2025-06/20/c_1752129980667315.htm.

[参考文献]

[1] 陈红卫、柳源远:《<人工智能法治研究十大议题(2026)>发布》,载法治日报法治网,http://www.legaldaily.com.cn/index/content/2026-03/27/content_9364275.html,2026年3月27日访问。

[2] 石钛戈、张宜轩:《善弈者谋势——从近期执法案例看AIGC服务提供者合规重点》,载北京市竞天公诚律师事务所公众号,2025年11月。

[3] 赵精武:《网络法治须与技术创新同频共振》,载法治日报法治网,http://h5epaper.legaldaily.com.cn/content/20260325/Articel05003SR.htm,2026年3月27日访问。

[4] 刘宪权:《涉生成式人工智能数据犯罪刑法规制新路径》,载《当代法学》2024年第6期。

[5] 中央网信办:《中央网信办深入开展“清朗·整治AI技术滥用”专项行动第一阶段工作》,载中国网信网,https://www.cac.gov.cn/2025-06/20/c_1752129980667315.htm,2026年3月27日访问

[6] 薛澜:《应对智能体治理风险,必须坚持以人为本、智能向善原则》,载清华大学战略与安全研究中心,2026年3月。

[7] 石钛戈、张宜轩:《不动声色、自有分寸——中国的AI治理2025年度回顾及展望》,载律商视点,2026年1月。

[8] 徐赫泽:《CSET|AI智能体自主性对中国数据治理框架的适配性挑战》,载清华大学人工智能国际治理研究院,2026年3月。

[9] 张帅杰:《斩断非法获取数据的暴利链条》,载常州天宁检察《检察日报》,2025年6月3日。